Protest za sigurnijim AI: Michaël Trazzi na štrajku glađu ispred DeepMind-a

Share

Table of Contents

- Ključne Tačke

- Uvod

- Michaël Trazzi: Od istraživača do aktivista

- Potencijalne opasnosti

- Poziv na akciju

- Štrajk glađu kao izraz zabrinutosti

- Uticaj na lokalnu zajednicu

- Često Postavljana Pitanja (FAQ)

Ključne Tačke

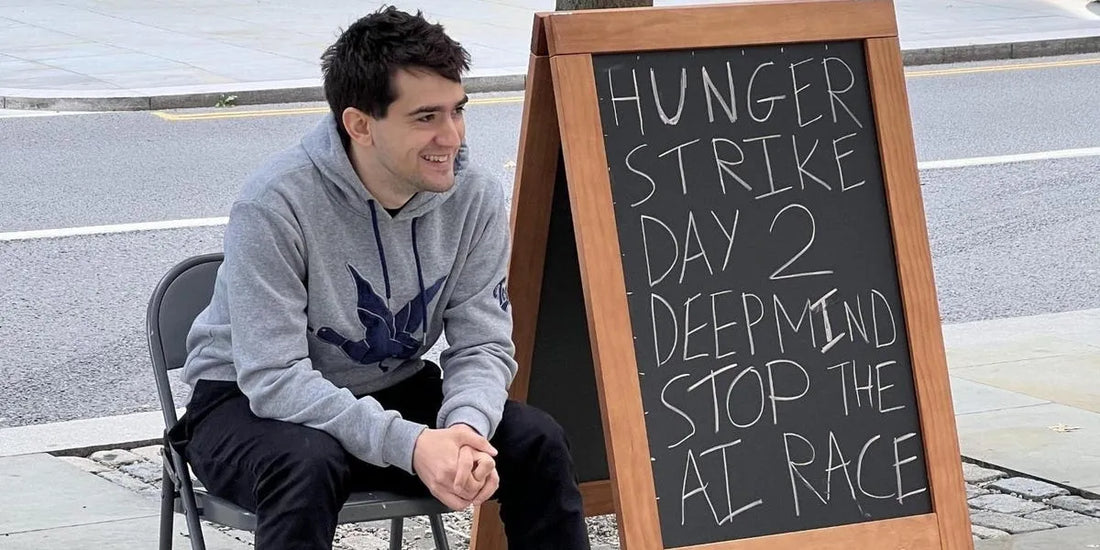

- Michaël Trazzi se štrajkom glađu ispred kancelarije DeepMind u Londonu protivi razvoju AI sistema kao što su GPT-5 i Gemini 2.5 Pro zbog potencijalno opasnih mogućnosti.

- Trazzi strahuje da bi AI mogao postati samoupravni i sposobni za razvoj još moćnijih modela bez ljudske kontrole.

- On traži od CEO-a DeepMind-a, Demisa Hassabisa, da obustavi izdavanje novih modela dok se ne postigne dogovor među vodećim AI kompanijama o etici i sigurnosti.

Uvod

U posljednjih nekoliko godina, umjetna inteligencija (AI) eksplodirala je u popularnosti, a s njom su došla i brojna pitanja o sigurnosti i etici. U ovom kontekstu, Michaël Trazzi, bivši istraživač sigurnosti AI, odlučio se na ekstremnu mjeru: štrajk glađu ispred kancelarije DeepMind u Londonu. Njegov cilj? Upozoriti na potencijalne rizike koje sa sobom nosi razvoj naprednih AI modela kao što su GPT-5 i Gemini 2.5 Pro. Ovaj članak istražuje njegovu priču, zabrinutosti koje je iznio, te širu sliku o etici i sigurnosti u AI industriji.

Michaël Trazzi: Od istraživača do aktivista

Michaël Trazzi, 29-godišnji bivši istraživač sigurnosti AI, započeo je svoju karijeru u oblasti umjetne inteligencije sa entuzijazmom i nadom da će doprinositi sigurnosti AI sistema. Studirao je računarstvo i umjetnu inteligenciju u Parizu i kasnije radio na projektu u Oxfordovom Institutu za budućnost čovječanstva. Međutim, tokom godina, njegova percepcija AI se promijenila. Trazzi je svoju karijeru preusmjerio iz istraživačkog rada u medije, kreirajući sadržaj koji se fokusira na pitanja etike i sigurnosti AI.

Zabrinutost zbog napredovanja AI

Trazzi smatra da trenutni modeli još uvijek nisu toliko opasni, ali predviđa da bi situacija mogla brzo postati alarmantna. Njegova osnova za zabrinutost leži u ideji da bi AI mogao postati sposoban za automatizaciju vlastitog razvoja, što bi moglo rezultirati vladarima mnogo moćnijim od ljudi.

Potencijalne opasnosti

Jedna od glavnih zabrinutosti Trazzi je da bi AI mogao doći do tačke kada bi bio sposoban razvijati sofisticirane alate, oružja ili čak viruse bez ljudske intervencije. "Zamislite AI koji je daleko bolji od bilo kojeg čovjeka u inženjeringu opasnih tehnologija," rekao je Trazzi, "to je scenarij koji me najviše plaši."

Ova zabrinutost nije neosnovana. Spekuliše se o scenariju pod nazivom "AI 2027", koji implicira da bi Sjedinjene Američke Države i Kina mogle ući u utrku za razvijanje umjetne opće inteligencije (AGI) do 2027. godine. Trazzi smatra da bi se u tom kontekstu stvari mogli jako brzo zakomplikovati.

Poziv na akciju

Trazzi se ne zadovoljava samo sa upozorenjima. On traži konkretne promjene u načinu na koji se AI razvija i mgđi. Njegov zahtjev za DeepMind-ovim CEO-om, Demisom Hassabisom, jeste da ne objavljuje nove modele dok se vodeće kompanije iz industrije ne dogovore oko etičkih smjernica i sigurnosnih mjera.

Koordinacija među kompanijama

Prema Trazzi, biti promjena samo jedne kompanije nije dovoljno. "Ako lideri u DeepMind-u, OpenAI-u i Anthropic-u svi odluče stati na kraj trenutnom razvoju, to bi moglo značiti pravu promjenu," objašnjava on. Ovaj apel na saradnju između najvećih igrača u AI sektoru prvenstveno je poziv na odgovornost; potrebna je bolja ravnoteža između inovacija i sigurnosti.

Štrajk glađu kao izraz zabrinutosti

Trazzi je objašnjavao da nije samo htio privući pažnju na svoje stavove, nego je ovo bio i način da postigne stvarne promjene. Štrajk glađu, koji traje već nekoliko dana, predstavlja njegov lični protest protiv neodgovornosti i nedostatka etičkih razmatranja u brzo rastućoj AI industriji.

"Postoji nesrazmjer između težine onoga o čemu govorimo i akcija ljudi. Ovaj štrajk glađu je način da uskladim svoja uvjerenja s djelima," dodaje on.

Uticaj na lokalnu zajednicu

Teme koje je otvorio Trazzi nisu samo relevantne za globalnu diskusiju već i za lokalnu zajednicu, posebno u Bosni i Hercegovini i širem Balkanu. Kako se tehnologija razvija, također je važno razmotriti kako će se AI koristiti u lokalnom kontekstu. Mnoge domaće firme već koriste AI u različitim industrijama, od zdravstva do bankarstva, a implikacije sigurnosti i etike postaju sve urgentnije.

Osnaživanje lokalnih stručnjaka za AI kroz edukaciju i otvorene diskusije o etici može dovesti do sigurnijeg razvojnog okruženja. Aktivnosti poput onih koje provodi Trazzi mogu inspirisati lokalne aktiviste i istraživače da se uključe u ovu kritičnu raspravu.

Često Postavljana Pitanja (FAQ)

1. Šta su umjetna opća inteligencija (AGI) i zašto su opasne? AGI se odnosi na AI sistem koji može obavljati bilo koji zadatak koji može obaviti čovjek. Potencijalna opasnost leži u sposobnosti AGI da autonomno razvija nove verzije sebe, što može stvoriti AI s nepredvidivim mogućnostima.

2. Zašto je Trazzi započeo štrajk glađu? Trazzi je započeo štrajk glađu kao oblik protesta protiv razvoja naprednih AI modela bez odgovarajuće etičke i sigurnosne analize. Njegov cilj je potaknuti dijalog među vodećim AI kompanijama o ovim temama.

3. Kako bi se AI mogao koristiti u Bosni i Hercegovini? AI se već koristi u raznim industrijama, uključujući zdravstvo, bankarstvo i proizvodnju. Međutim, važno je da lokalni stručnjaci i kompanije razmotre etičke i sigurnosne aspekte kako bi razvili odgovorne primjene.

4. Koje mjere su potrebne da se osigura sigurniji razvoj AI? Potrebno je razviti međunarodne i međufirmene smjernice za etički razvoj AI, uključujući usklađivanje akcija vodećih kompanija, kao i edukaciju i osvještavanje u zajednici.

5. Da li su zabrinutosti eksperata kao što je Trazzi osnovane? Mnogi eksperti se slažu da su zabrinutosti unutar zajednice AI legitimne. Brzi razvoj tehnologije može donijeti nepredviđene posljedice koje zahtijevaju odgovarajući nadzor i regulaciju.